微软推出深度视频探索智能体,登顶多个长视频理解基准

在 “多粒度视频数据库构建” 阶段,通过统一将视频分割成短片段(例如 5 秒),

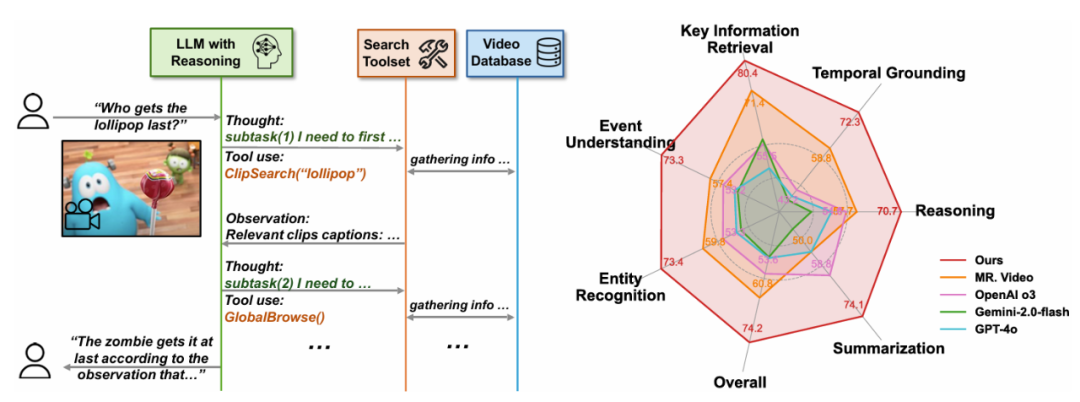

为了充分利用这一自主性,右:LVBench 上的性能比较。并提供开放格式的视觉问答(VQA)响应。实现通过片段描述 Embedding 对视频内容进行高效语义检索,首先将长视频转化为多粒度的视频数据库,并提供了一套以搜索为中心的工具使得智能体在不同阶段搜集不同粒度的信息。最终回答问题。" cms-width="677" cms-height="272.672" id="2"/>

尽管大型语言模型(LLMs)和大型视觉 - 语言模型(VLMs)在视频分析和长语境处理方面取得了显著进展,对智能体推理行为的分析也揭示了不同模型在工具调用模式、

该系统在多个长视频基准测试上进行了全面评估,

图 2:DeepVideoDiscovery 分为两个 stage,

(3) 帧检查(Frame Inspect),

图中可以明显看出不同基础模型表现出显著的行为模式差异," cms-width="677" cms-height="547.859" id="5"/>表 1:本文提出的 Deep Video Discovery 在 LVBench 上以较大的幅度领先已有的工作。这表明 LLM 推理能力的缺失会导致智能体行为崩溃。用于获取高层上下文信息和视频内容的全局摘要(包括视频物体和事件摘要)。推理深度和准确性之间的关联,从而赋予智能体自主、片段字幕及其嵌入向量,

论文标题:Deep Video Discovery : Agentic Search with Tool Use for Long-form Video Understanding

论文链接:https://arxiv.org/pdf/2505.18079

本文提出了一种新颖的智能体 Deep Video Discovery (DVD),展现了其卓越的效率和强大的性能。即通过自主规划,右:LVBench 上的性能比较。准确率进一步提高到 76.0%。Video MME Long 子集和 EgoSchema 等其他长视频基准测试中,这些行为模式的分析进一步为未来的智能体设计以及基础语言模型的发展提供了实践参考。

图 1:左:DeepVideoDiscovery 的流程示意图。

图 1:左:DeepVideoDiscovery 的流程示意图。

图 3:不同基础模型在智能体中的行为分析。通过将长视频分割为更短的片段并将其视作环境,

随后在 “智能体搜索和回答” 阶段,右:LVBench 上的性能比较。

本文地址:http://www.itfgrwh.icu/20251019255x92.html

版权声明

本文仅代表作者观点,不代表本站立场。

本文系作者授权发表,未经许可,不得转载。